Việc tối ưu hóa công cụ tìm kiếm luôn đòi hỏi sự cập nhật liên tục, đặc biệt là việc xử lý các vấn đề nền tảng. Ngay cả một thao tác tưởng chừng đơn giản như cách thoát Outlook trên máy tính cũng đòi hỏi sự am hiểu về hệ thống, tương tự như việc khắc phục các Lỗi Kỹ Thuật SEO phức tạp trên website. Bài viết này sẽ đi sâu phân tích top các lỗi kỹ thuật phổ biến nhất, từ vấn đề tốc độ tải trang chậm chạp đến trải nghiệm di động chưa được tối ưu, ảnh hưởng trực tiếp đến thứ hạng. Chúng tôi tập trung vào cung cấp các giải pháp chuyên sâu cho những vấn đề về cấu trúc URL và tối ưu hóa Internal Link, nhằm giúp website đạt hiệu suất E-E-A-T cao nhất, loại bỏ các lỗi cản trở như lỗi 404 chưa được quản lý.

Phân Tích Nguyên Nhân Cốt Lõi Dẫn Đến Lỗi Kỹ Thuật SEO

Lĩnh vực SEO liên tục thay đổi theo các bản cập nhật thuật toán của Google. Các chuyên gia buộc phải duy trì việc học hỏi không ngừng để theo kịp. Việc mắc phải các lỗi kỹ thuật SEO thường phổ biến ở người mới, những người chưa có nhận thức đầy đủ về nền tảng hoặc chưa hiểu đúng về các nguyên tắc cốt lõi.

Nguyên nhân sâu xa thường nằm ở sự thiếu hụt kiến thức kỹ thuật cơ bản. Ví dụ, việc sử dụng thẻ H1 không đúng mục đích—không dùng cho tiêu đề chính—là một sai sót thường thấy. Việc này cho thấy sự chưa thành thạo về cấu trúc thẻ HTML. Một nguyên nhân khác là khoảng cách giữa đội ngũ phát triển website (Developer) và đội ngũ SEO. Thường xuyên, các thay đổi kỹ thuật bị bỏ qua, dẫn đến việc mã nguồn không chuẩn SEO ngay từ đầu.

Nền Tảng Kỹ Thuật Yếu Kém và Tác Động Đến E-E-A-T

Thiếu hụt các cuộc kiểm toán (audit) định kỳ và chuyên sâu cũng là nguyên nhân lớn. Nếu không quét website thường xuyên bằng các công cụ chuyên dụng, các vấn đề như nội dung kém chất lượng (Thin Content) hay chuỗi chuyển hướng (Redirect Chain) sẽ tích tụ. Điều này làm giảm đáng kể các tín hiệu về Chuyên môn (Expertise) và Độ tin cậy (Trustworthiness).

Sự thiếu kiểm soát còn thể hiện qua việc chọn từ khóa sai. Việc này dẫn đến việc tạo ra nội dung không đáp ứng ý định tìm kiếm của người dùng. Từ đó, website bị đánh giá thấp về trải nghiệm. Sự kết hợp giữa kỹ thuật kém và chiến lược nội dung sai lầm tạo nên rào cản lớn nhất.

Các Lỗi Kỹ Thuật Onpage Phổ Biến và Chiến Lược Khắc Phục Chuyên Sâu

Các lỗi Onpage tác động trực tiếp lên trang web và dễ dàng được kiểm soát hơn. Tuy nhiên, chúng đòi hỏi sự can thiệp kỹ thuật chính xác và kịp thời.

Tốc Độ Tải Trang Website Quá Chậm (Core Web Vitals)

Tốc độ tải trang là một yếu tố xếp hạng chính thức (Ranking Factor) của Google. Tốc độ lý tưởng nhất là dưới 3 giây. Nếu website của bạn chậm hơn đối thủ, người dùng sẽ rời đi, làm tăng tỷ lệ thoát và giảm tỷ lệ chuyển đổi. Điều này ảnh hưởng tiêu cực đến doanh thu.

Nguyên nhân chủ yếu bao gồm việc chưa tối ưu hóa kích thước hình ảnh. Các hình ảnh quá lớn làm tăng dung lượng tải. Mã nguồn web không chuẩn, chứa nhiều CSS và Javascript không cần thiết, làm chậm quá trình dựng trang. Việc cài đặt quá nhiều plugins cũng là gánh nặng cho máy chủ.

Tối Ưu Hóa Core Web Vitals (CWV)

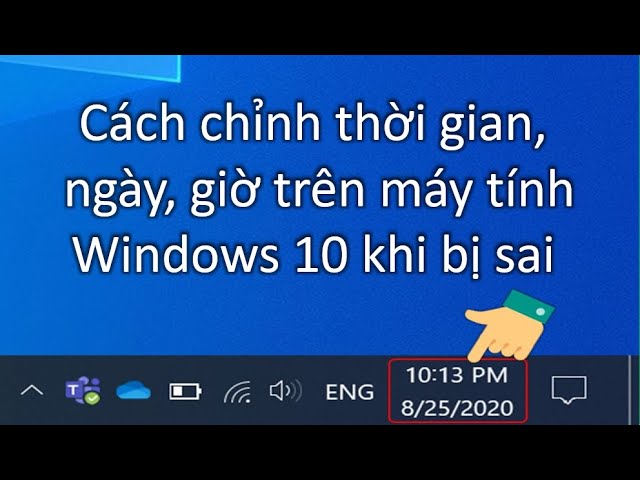

Để khắc phục, bạn cần kiểm tra hiệu suất trên các công cụ như PageSpeed Insights, GTMetrix. Việc này cung cấp dữ liệu chi tiết về các chỉ số CWV như Largest Contentful Paint (LCP) và Cumulative Layout Shift (CLS). LCP dưới 2.5 giây là mục tiêu cần đạt.

Các biện pháp kỹ thuật bao gồm nâng cấp phiên bản PHP lên 7.4 hoặc 8.0 để tăng hiệu suất xử lý. Bắt buộc phải triển khai kỹ thuật “Lazy Loading” cho hình ảnh và video. Loại bỏ hoặc trì hoãn việc tải (defer loading) các tài nguyên chặn hiển thị (render-blocking resources) như CSS và JavaScript.

Ảnh minh họa kiểm tra tốc độ tải trang bằng các công cụ chuyên nghiệp để tối ưu hóa lỗi kỹ thuật SEO

Ảnh minh họa kiểm tra tốc độ tải trang bằng các công cụ chuyên nghiệp để tối ưu hóa lỗi kỹ thuật SEO

Chưa Tối Ưu Hóa Trải Nghiệm Di Động (Mobile-First Indexing)

Thuật toán của Google đã chuyển sang ưu tiên lập chỉ mục theo di động (Mobile-First Indexing). Điều này có nghĩa là phiên bản di động của website là cơ sở để Google đánh giá xếp hạng. Không tối ưu trải nghiệm di động (UX) là một lỗi kỹ thuật nghiêm trọng.

Sử dụng Mobile-Friendly Test là cách nhanh nhất để kiểm tra tính tương thích. Bạn cũng cần kiểm tra xem Googlebot di động có thu thập thông tin trang web đúng cách hay không. Đảm bảo rằng thiết kế là Responsive (đáp ứng) chứ không phải dùng các URL di động riêng biệt (m-dot sites).

Các Chỉ Số Cần Can Thiệp Trên Mobile

Tập trung vào việc xây dựng trang web ưu tiên thiết bị di động ngay từ đầu. Cần thiết lập nhiều điểm ngắt (breakpoint) phù hợp với các kích thước màn hình khác nhau. Đảm bảo kích thước mục tiêu chạm (touch target size) đủ lớn để người dùng dễ dàng thao tác. Kiểm tra tính năng của website trên cả hệ điều hành iOS và Android. Cân nhắc chuyển sang HTML5 để hiển thị nội dung tốt hơn trên các thiết bị di động hiện đại.

Ảnh minh họa một website được kiểm tra về mức độ thân thiện với thiết bị di động thông qua công cụ Mobile-Friendly Test

Ảnh minh họa một website được kiểm tra về mức độ thân thiện với thiết bị di động thông qua công cụ Mobile-Friendly Test

Cấu Trúc URL Kém Gây Khó Khăn Cho Thu Thập Dữ Liệu

Cấu trúc URL đóng vai trò là dấu vết phân cấp của website. Cấu trúc kém gây khó khăn cho cả người dùng và công cụ tìm kiếm. Nó tác động tiêu cực đến khả năng Google hiểu được sự liên quan và tầm quan trọng của các trang.

Các vấn đề thường gặp là cấu trúc thư mục và thư mục con không được tổ chức hợp lý. URL chứa các ký tự đặc biệt, chữ in hoa, hoặc các tham số động không thân thiện với SEO. Quan trọng nhất là không kiểm tra báo cáo lỗi thu thập dữ liệu (Crawl Errors) trong Google Search Console.

Xây Dựng Cấu Trúc URL Chuẩn SEO

Giải pháp là lập kế hoạch cấu trúc trang web dựa trên cấp độ, sử dụng cấu trúc thư mục mẹ và thư mục con rõ ràng. Nội dung cần được đặt trong các thư mục phù hợp với chủ đề. URL phải dễ đọc, có ý nghĩa và chứa từ khóa chính.

Giới hạn số lượng cấp độ thư mục con không nên vượt quá ba. Điều này giúp giữ “độ sâu” của trang (Click Depth) ở mức thấp. Đồng thời, áp dụng thẻ Canonical hóa (Canonical Tag) chính xác để tránh trùng lặp nội dung do các phiên bản URL khác nhau gây ra.

Chứa Nhiều Nội Dung Kém Chất Lượng (Thin Content)

Một website chứa nhiều trang có nội dung kém chất lượng sẽ ảnh hưởng nghiêm trọng đến tổng thể SEO. Nội dung mỏng (dưới 500 từ) hoặc nội dung không đáp ứng nhu cầu khách hàng làm giảm tỷ lệ tiếp cận và cản trở việc thu thập dữ liệu (crawl budget) của Google.

Google ngày càng khắt khe, đề cao chất lượng content và tính liên kết chặt chẽ của website. Nội dung kém chất lượng làm giảm tỷ lệ lập chỉ mục (Index) và lượng traffic. Dấu hiệu nhận biết là số lượng từ của trang dưới ngưỡng cho phép và tỷ lệ thoát trang (Bounce Rate) cao.

Chiến Lược Content Pruning và Nâng Cao Chất Lượng

Thay vì viết content cho từng từ khóa nhỏ, hãy gộp nhiều từ khóa cùng một chủ đề vào một bài viết toàn diện (Topic Cluster). Điều này tạo ra các bài viết có mối tương quan chặt chẽ. Tập trung vào việc thêm giá trị bằng hình ảnh, video, âm thanh, hoặc infographics.

Tiến hành Content Pruning: rà soát và xóa bỏ hoặc cải thiện các trang Zombie (trang có ít traffic, ít backlink). Nâng cấp nội dung bằng cách bổ sung chi tiết, phân tích chuyên sâu, và dẫn chứng chuyên môn để tăng cường tín hiệu E-E-A-T.

Ảnh minh họa việc đánh giá chất lượng nội dung và các chiến lược cải tiến nội dung để tối ưu hóa SEO

Ảnh minh họa việc đánh giá chất lượng nội dung và các chiến lược cải tiến nội dung để tối ưu hóa SEO

Chưa Tối Ưu Thẻ Meta Description

Thẻ Meta Description là yếu tố quan trọng quyết định tỷ lệ nhấp (Click-Through Rate – CTR) của bài viết trên trang kết quả tìm kiếm (SERP). Nếu thiếu thẻ này, Google sẽ tự động lấy một đoạn văn bản bất kỳ từ bài viết, dẫn đến việc mô tả không hấp dẫn.

Lỗi thường gặp là thẻ Meta Description quá dài, không thể hiển thị đầy đủ. Hoặc thẻ bị nhồi nhét quá nhiều từ khóa, gây khó chịu cho người đọc. Việc thiếu Meta Description làm lãng phí cơ hội thu hút người dùng.

Tối Ưu Hóa CTR Bằng Meta Description

Sử dụng công cụ như Screaming Frog để kiểm tra các bài viết bị thiếu hoặc có Meta Description quá dài. Meta Description nên nằm trong giới hạn ký tự (khoảng 155-160 ký tự, cần kiểm tra giới hạn pixel chính xác hơn).

Nội dung Description cần chứa từ khóa chính, mô tả lợi ích rõ ràng và khuyến khích hành động (Call-to-Action) một cách tinh tế. Luôn kiểm tra và bổ sung Description đầy đủ trước khi đăng bài.

Ảnh minh họa lỗi Meta Description bị thiếu hoặc quá dài trên các công cụ kiểm tra

Ảnh minh họa lỗi Meta Description bị thiếu hoặc quá dài trên các công cụ kiểm tra

Sai Sót Trong Tối Ưu H1 và Title Tag

Title Tag (Thẻ Tiêu đề) là phần quan trọng nhất, xuất hiện đầu tiên trên SERP và là yếu tố ảnh hưởng lớn đến quyết định truy cập của người dùng. H1 (Tiêu đề chính) là chỉ dẫn ngữ nghĩa mạnh mẽ nhất trên trang, giúp Google hiểu chủ đề chính.

Lỗi phổ biến là H1 không chứa từ khóa chính hoặc LSI keyword. H1 bị thiếu hoặc không được đặt ở đầu bài viết. Title Tag bị trùng lặp trên nhiều bài viết khác nhau của website.

Tiêu Chuẩn H1/Title Tối Ưu

H1 và Title nên là hai thực thể riêng biệt nhưng có liên quan mật thiết. H1 chỉ được sử dụng một lần duy nhất trên mỗi trang. Cần chèn từ khóa chính vào H1 và Title, ưu tiên đặt ở đầu. Giới hạn số lượng ký tự cho Title (khoảng 60-70 ký tự hoặc 600 pixel).

Sử dụng cú pháp tên title để kiểm tra Title có bị trùng lặp trên web khác hay không. Điều chỉnh các bài viết thiếu H1 và Title dựa trên kết quả kiểm tra để đảm bảo tính duy nhất và liên quan.

Ảnh minh họa việc tối ưu H1 và Title Tag, đảm bảo chứa từ khóa và có độ dài hợp lý

Ảnh minh họa việc tối ưu H1 và Title Tag, đảm bảo chứa từ khóa và có độ dài hợp lý

Các Nội Dung Không Liên Quan và Thiếu Tập Trung Chủ Đề

Việc có các bài viết không liên quan đến chủ đề cốt lõi của website sẽ làm giảm hiệu quả SEO tổng thể. Các nội dung trong bài phải liên kết logic với nhau. Các trang không có mục đích rõ ràng hoặc không đóng góp giá trị cho người dùng được gọi là Orphan Pages (Trang mồ côi).

Tình trạng này làm giảm hiệu quả hoạt động trên trang, phân tán thẩm quyền liên kết (Link Equity) và làm mờ ý định tìm kiếm chính của website. Việc tạo ra quá nhiều bài viết riêng lẻ cho từng từ khóa gần giống nhau cũng gây ra hiện tượng Keyword Cannibalization (Ăn thịt từ khóa).

Tập Trung Vào Content Silo và Giá Trị Cốt Lõi

Khắc phục lỗi này bằng cách xem xét lại toàn bộ chiến lược nội dung (Content Timeline). Tập trung bổ sung giá trị và làm rõ mục đích của từng bài viết. Sử dụng mô hình Topic Cluster/Content Silo để tổ chức các bài viết liên quan thành nhóm.

Nếu có các trang không cần thiết hoặc không muốn Google xếp hạng, cần thêm chúng vào tệp robots.txt (để chặn thu thập dữ liệu) hoặc sử dụng thẻ noindex (để chặn lập chỉ mục). Việc này giúp tập trung “ngân sách thu thập dữ liệu” (Crawl Budget) vào các trang quan trọng.

Không Tận Dụng Triệt Để Internal Link

Internal Link (Liên kết nội bộ) là cơ chế quan trọng giúp phân phối thẩm quyền liên kết và xây dựng mạng lưới ngữ nghĩa trên website. Các bài viết liên kết với nhau giúp Google hiểu rõ về nội dung, tầm quan trọng, và cấu trúc của trang web.

Việc thiếu liên kết nội bộ làm cản trở việc truyền tải sức mạnh SEO giữa các trang. Điều này làm giảm khả năng cải thiện thứ hạng của các từ khóa liên quan. Một từ khóa lên top có thể kéo các từ khóa khác lên theo nếu có hệ thống Internal Link tốt.

Tối Ưu Hóa Sức Mạnh Liên Kết Nội Bộ

Sử dụng công cụ Google Analytics và Screaming Frog để kiểm tra cấu trúc Internal Link hiện tại. Bổ sung thêm nội dung mới và lồng ghép Internal Link một cách tự nhiên, không nhồi nhét. Anchor Text (văn bản neo) phải đa dạng và mang tính mô tả cao, giúp người dùng và Google hiểu về trang đích.

Đảm bảo rằng các liên kết quan trọng không bị thiết lập dưới dạng nofollow. Xây dựng cấu trúc Silo cứng hoặc mềm để dòng chảy liên kết nội bộ được tối ưu, truyền sức mạnh từ các trang có thẩm quyền cao đến các trang cần SEO.

Ảnh minh họa mạng lưới Internal Link (liên kết nội bộ) trên một website

Ảnh minh họa mạng lưới Internal Link (liên kết nội bộ) trên một website

Lỗi Kỹ Thuật Hạ Tầng (Site Infrastructure) và Offpage

Các lỗi này liên quan đến cấu hình máy chủ, tập tin cấu hình và quản lý các liên kết bên ngoài. Việc xử lý chúng đòi hỏi kiến thức chuyên môn sâu hơn về phía máy chủ.

Lỗi 404 Chưa Được Quản Lý Chặt Chẽ

Lỗi 404 (Không tìm thấy trang) xảy ra khi một URL đã từng tồn tại nhưng sau đó bị xóa hoặc hết hạn. Việc bỏ qua các trang lỗi 404 làm lãng phí Crawl Budget. Hơn nữa, nếu các trang này có Backlink trỏ đến, việc không xử lý sẽ làm mất đi Link Equity quý giá.

Sử dụng SiteBulb, DeepCrawl, hoặc Screaming Frog để thu thập dữ liệu và xác định các trang 404. Quan trọng là phải kiểm tra báo cáo trong Google Search Console. Phân tích danh sách lỗi 404 để xác định xem chúng là 404 Cứng (Hard 404) hay 404 Mềm (Soft 404 – trang trả về 200 OK nhưng nội dung là lỗi).

Giải Pháp Redirect và Tối Ưu Trang Lỗi

Thiết lập chuyển hướng vĩnh viễn (301 Redirect) từ URL bị lỗi 404 đến một trang liên quan nhất hoặc trang chủ. Cần kiểm tra kỹ để tránh tạo ra các chuỗi chuyển hướng (Redirect Chains). Tối ưu hóa trang 404 tùy chỉnh (Custom 404 Page) để hướng dẫn người dùng quay lại các trang quan trọng khác. Tuyệt đối không để lỗi 404 đi vào quên lãng.

Ảnh minh họa màn hình hiển thị lỗi 404 (Trang không tìm thấy) trên trình duyệt

Ảnh minh họa màn hình hiển thị lỗi 404 (Trang không tìm thấy) trên trình duyệt

Lỗi Về Sitemap XML

Sitemap XML là bản đồ giúp liệt kê các URL quan trọng mà bạn muốn Google thu thập thông tin và lập chỉ mục. Nó cung cấp các thông tin bổ sung như lần cuối cập nhật hay mức độ quan trọng của trang.

Lỗi thường gặp là không gửi sitemap đến Google Search Console hoặc sitemap bị lỗi cú pháp. Sitemap có thể chứa các URL không quan trọng, các URL bị chặn (Disallowed) hoặc các URL có thẻ noindex. Điều này gây nhiễu loạn cho quá trình thu thập dữ liệu.

Đảm Bảo Sitemap Luôn Chính Xác

Đảm bảo rằng Sitemap XML đã được kết nối và được gửi (Submit) thành công trong Google Search Console. Thường xuyên kiểm tra lỗi sitemap thông qua mục Thu thập thông tin (Crawl) > Sitemaps. Nếu sử dụng plugin tạo sitemap, hãy kiểm tra các bản cập nhật và cấu hình của plugin đó.

Phân tích nhật ký máy chủ (Log File Analysis) để hiểu tần suất Google truy cập sitemap. Chỉ đưa vào sitemap những URL muốn được lập chỉ mục và loại bỏ các URL trùng lặp hoặc không cần thiết.

Tệp Robots.txt Bị Lỗi

Tệp robots.txt là tập tin đầu tiên công cụ tìm kiếm truy cập, có chức năng hướng dẫn (không phải ngăn chặn tuyệt đối) Googlebot truy cập vào các phần khác nhau của website. Lỗi phổ biến nhất là nhập sai cú pháp hoặc vô tình chặn các thư mục quan trọng.

Nhiều người lầm tưởng robots.txt có thể ngăn chặn lập chỉ mục (Index) nhưng thực chất nó chỉ ngăn chặn thu thập dữ liệu (Crawl). Nếu một trang bị chặn trong robots.txt nhưng lại có Backlink trỏ đến, nó vẫn có thể bị Index.

Khắc Phục Lỗi Cú Pháp và Quản Lý Quy Tắc

Sử dụng công cụ robots.txt Tester trong Google Search Console để xác thực tệp. Hãy đảm bảo các trang hoặc thư mục bạn KHÔNG muốn Google thu thập dữ liệu đã được thêm vào tệp này. Quan trọng nhất, phải đảm bảo các thư mục quan trọng như JavaScript (JS), CSS, hoặc các trang có thẩm quyền cao KHÔNG bị chặn.

Phải hiểu rõ sự khác biệt giữa Disallow trong robots.txt và thẻ noindex trong HTML. Nếu muốn ngăn lập chỉ mục, phải dùng thẻ noindex. Nếu muốn ngăn chặn thu thập dữ liệu, mới dùng Disallow trong robots.txt.

Ảnh minh họa tệp robots.txt và cơ chế ngăn chặn công cụ tìm kiếm thu thập dữ liệu một phần của website

Ảnh minh họa tệp robots.txt và cơ chế ngăn chặn công cụ tìm kiếm thu thập dữ liệu một phần của website

Việc làm chủ các yếu tố kỹ thuật là nền tảng cốt lõi để website đạt được thứ hạng bền vững. Chúng ta đã đi sâu vào những lỗi phổ biến nhất, từ tốc độ tải trang đến các vấn đề về cấu trúc liên kết và quản lý file robots.txt. Khắc phục triệt để những điểm yếu này là bước đi chiến lược, giúp tăng cường tín hiệu E-E-A-T, đảm bảo hiệu suất thu thập dữ liệu (crawl budget) tối ưu. Nền tảng kỹ thuật vững chắc cho phép nội dung chất lượng được phát huy tối đa, giống như việc hiểu rõ nguyên lý hệ thống để thực hiện các thao tác quản trị phần mềm như cách thoát Outlook trên máy tính một cách chuyên nghiệp và không gặp trục trặc.

Ngày Cập Nhật 18/12/2025 by Trong Hoang

Chào các bạn, mình là Trọng Hoàng, tác giả của blog maytinhvn.net. Mình là một full-stack developer kiêm writer, blogger, Youtuber và đủ thứ công nghệ khác nữa.